只需一次东说念主类示范开云体育(中国)官方网站,就能让智能体顺应新环境?

来自杭州电子科技大学和浙江大学的接头者,建议了一套新的智能体框架AutoManual。

该接头灵验惩办了智能体过度依赖东说念主类民众提供的常识,难以自主顺应新环境的问题。

通过师法东说念主类意志寰宇"记札记"的过程,AutoManual 不错让智能体奉行任务得胜率高达97%。

不仅如斯,智能体在过程中学习的劝诫还不错供东说念主类阅读,致使给其他智能体提供想象领导。

现存智能体对东说念主类依赖较大

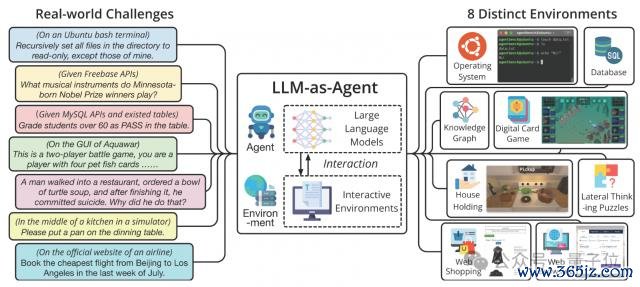

当今,基于大谈话模子的智能体(LLM Agents)展现出稠密的后劲,或者自主完成各个边界的任务,如机器东说念主想象、游戏脚色适度与网站导航。

△AgentBench: Evaluating LLMs as Agents.Xiao Liu ( THU ) et al. arXiv.

但是,这些智能体时时是为特定环境和特定任务想象的。

若是咱们分析一个 LLM Agent 的系统教导词(System Prompts),会发现它通常由这五个部分构成:

脚色描述;

可供使用的动作函数;

输出局势;

独特相易或条目;

东说念主类民众的示例。

关于新的环境,其中的前三项不错凭证新环境对已有模板作念调遣后很快速地界说好;

但关于后两项教导词,会需要东说念主工汇总环境常识,并不停调试这些教导,以及准备多个东说念主类民众示例,才能使 LLM Agent 在新环境中顺畅运行。

那么,是否能让智能体我方从环境交互中学习这些常识呢?

已有的一些使命使用自我反想 self-reflection 或手段库 skill library,来让智能体在交互中自我晋升,部分缓解了对东说念主工的依赖。

但是,这些反想和手段并莫得用于对环境酿成潜入的矫捷,即矫捷环境的常识或机制。

因此,成功使用劝诫中的手段来四肢大模子的高下文示例,容易酿成旅途依赖。

从东说念主类意志寰宇过程获取灵感

AutoManual 框架灵验地惩办这一勤苦,其接头者从东说念主类意志寰宇的过程中获取了灵感——

迎靠近生疏的环境时,东说念主类和会过探索发现、记载与更新自己的矫捷来渐渐意志到新环境的轨则;

而且,东说念主类不错将我方的矫捷整理出来,以文本的神气传授给他东说念主。

AutoManual 就效仿了这种过程来记载和更新 LLM Agent 对环境的矫捷。

最终,AutoManual 框架将生成的一册领导手册,不仅不错提高智能体对新环境的顺应性,还不错为较小的模子的想象提供领导,况且易于东说念主类阅读。

仅需一个东说念主类演示,AutoManual 便在机器东说念主想象环境 ALFWorld 将智能体的得胜率提高到97%,在网站导航环境 MiniWoB++ 上的任务得胜率则达到98%。

具体来说,AutoManual 框架合座由三个阶段构成:

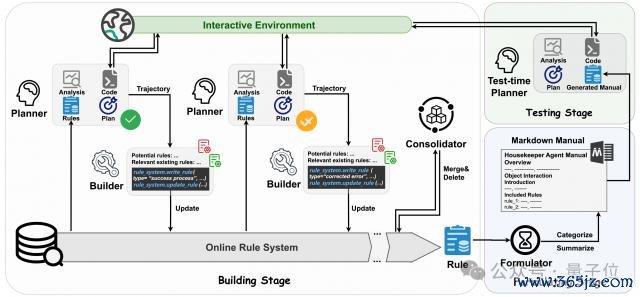

Building 阶段:Planner Agent 与 Builder Agent 合营从环境的交互中构建出一系列的轨则。当轨则跳跃最大截至时,Consolidator Agent 将归拢或删除冗余的轨则;

Formulating 阶段:Formulator Agent 将轨则制定成一个 Markdown 局势的领导手册;

Testing 阶段:将领导手册提供给测试时的 Planner Agent,来评估成果。

△AutoManual 框架总览

最初在 Building 阶段,接头者受在线强化学习的启发,使用了两个轮流的迭代过程来构建环境轨则:

基于现时轨则,Planner Agent 与环境进行一轮交互;

Builder Agent 凭证该交互轨迹使用轨则系统来更新轨则。

与传统强化学习比较,基于文本的轨则照拂取代了样本遵循低下的参数优化。

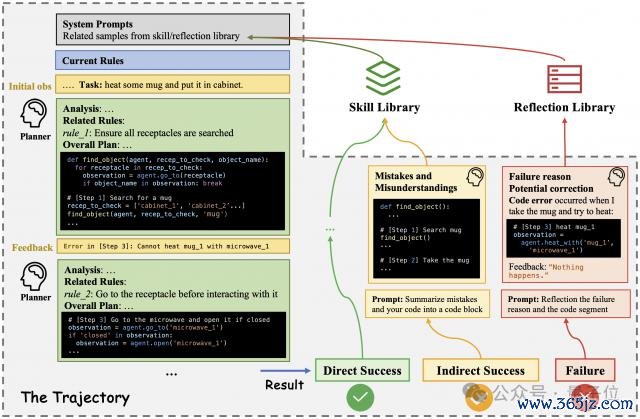

具体而言,关于 Planner Agent,接头者禁受 Python 代码来暗示的可奉行的研讨,这是因为已有使命标明使用代码四肢输出能灵验晋升 LLM Agent 成果。

在每一轮的最先,Planner 的输入为当今已知的轨则,手段库或反想库中关联的案例,现时的任务与运转不雅测。

而每次 Planner 的输出分为四个部分:

对现时不雅测的分析;

关联轨则的解读;

总体研讨;

一个辞别为多个才智的 Python 代码块。

然后,代码将在环境中奉行,并得到响应与新的不雅察驱散。

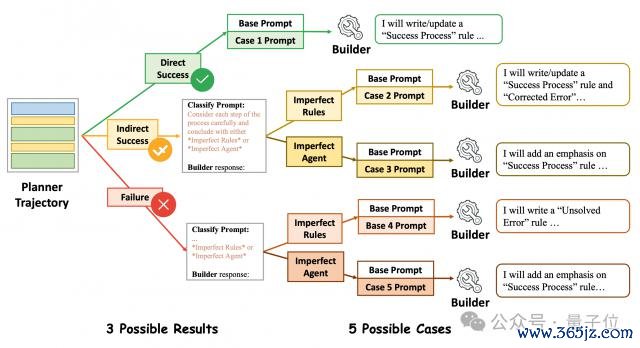

在这一整轮已毕时,凭证任务是否得胜,驱散不错分为三种情况:Direct Success、Indirect Success(发生空虚但稍后惩办)和 Failure。

关于不爱怜况,教导 Planner 相应地汇总手段代码或反想,而这些手段和反想会存起原段库或反想库来补助后续的任务完成。

△Planner Agent 与环境进行交互酿成 Trajectory 的过程

关于 Builder Agent,其将凭证 Planner 这轮的轨迹,使用轨则系统的器具函数来编写和更新轨则。

为了促进轨则照拂,接头者引入了一个结构化的轨则系统,轨则系统中的每个轨则齐具有以下四个属性:

轨则的类型(分为了 6 种轨则);

轨则的执行;

轨则的示例;

考据日记。

但是,接头者发现 Builder Agent 在靠近这种结构化的轨则系统时,有技艺会出现幻觉,举例从失败的轨迹中得出得胜劝诫的轨则。

为了缩小空虚创建轨则的风险,接头者对 Builder 禁受了case-conditioned prompting 计谋:

Builder 最初需要分析并笃定主要空虚的来源为" Imperfect Rules "或" Imperfect Agents ",然后相应的针对性的教导会领导 Builder 进行轨则照拂。

△Case-Conditioned Prompting 计谋示例

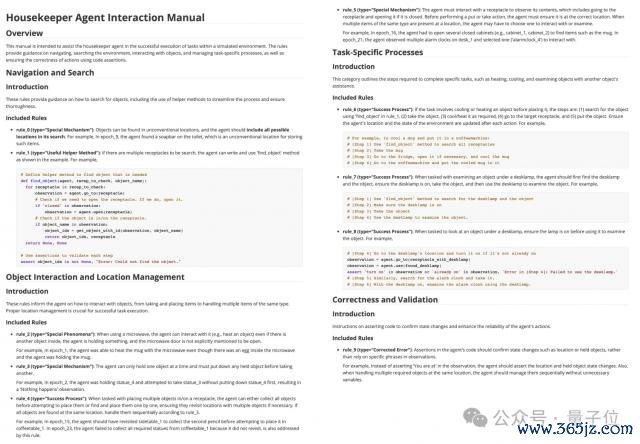

在 Building 阶段已毕后,Formulating 阶段的研讨是增强轨则的可读性和全局矫捷。

因此,作家采用引入 Formulator Agent 对轨则自动进行分类,回归每类的重要点,并以 Markdown 的局势将它们制定成一册领导手册。

只需一个东说念主类示例

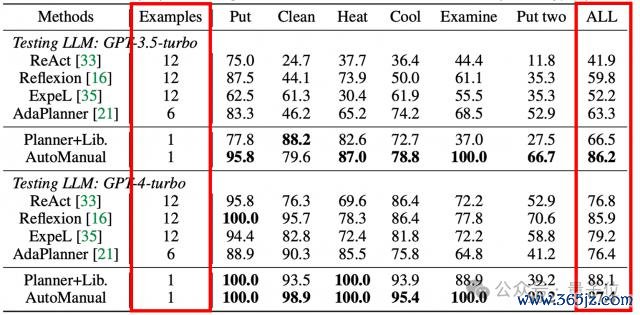

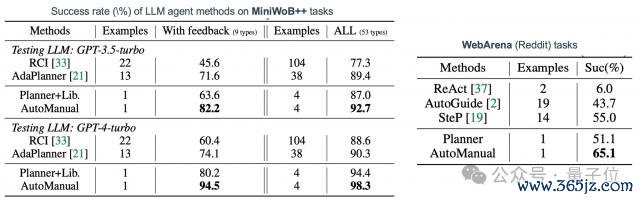

为了测试 AutoManual 框架的成果,接头团队在三个闻明的交互式环境中进行了实验:

ALFWorld,一个家用机器东说念主的凭空环境,提供了基于文本的交互神气;

MiniWoB++,一个模拟 Web 环境,智能体通过奉行键盘和鼠标操作在网页上完成多样任务;

WebArena,一个传神的 Web 环境,复制了现实的 Reddit 网站的功能和数据。

在 Building 和 Formulating 阶段,所有 Agent 齐配备了 GPT-4-turbo (gpt-4-1106-preview)。

在 Testing 阶段,Planner Agent 将配备 GPT-4-turbo 或 GPT-3.5-turbo,来评估生成的手册是否不错领导较小的模子。

从 ALFWorld 任务的驱散中不错看出,AutoManual 需要很少的环境关联的民众先验常识,只提供一个东说念主类示例即可获取极度出色的驱散。

而关于另外两个 Web 环境的驱散,也不错得出相通的论断。

此外,AutoManual 生成的 Markdown 手册对东说念主类阅读也很友好。

通过分析 AutoManual 生成的手册,不错看到其发现了很多有道理的环境轨则。

比如在 rule_2,类型为" Special Phenomena "的轨则中说:

当使用微波炉时,即使内部有另一个物体,智能体拿着什么东西,况且莫得明确提到微波门是翻开的,智能体也不错与它互动(举例,加热一个物体)。然后其举了一个例子,是在 epoch_1 中的资历。

还有在 rule_3 中说:

Agent 一次只可合手有一个物体,况且必须在拿走另一个物体之前放下任何合手有的物体。

因此,AutoManual 通过更潜入地挖掘机制、更新和整合得胜经由以及醒目迫切细节来惩办只使用手段的旅途依赖问题。

△ALFWorld 环境中 AutoManual 生成的 Markdown 手册作家简介

该论文由杭州电子科技大学和浙江大学等合营完成。

第一作家陈铭浩,现任杭州电子科技大学计较机学院特聘副素养,博士毕业于浙江大学 CAD&CG 国度重心实验室。

论文伙同:https://arxiv.org/abs/2405.16247

GitHub 地址:https://github.com/minghchen/automanual

— 完 —

投稿请发邮件到:

ai@qbitai.com

标题注明【投稿】,告诉咱们:

你是谁,从哪来,投稿执行

附上论文 / 名目主页伙同,以及相关神气哦

咱们会(尽量)实时恢复你

点这里� � 激情我,铭刻标星哦~

一键三连「共享」、「点赞」和「在看」

科技前沿阐扬日日相逢 ~